| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 | 31 |

- 머신러닝

- level 2

- 빅분기

- sklearn

- 실기

- Python

- 실습

- level 1

- SQL

- oracle

- Oracel

- 코딩테스트

- matplotlib

- python3

- 알고리즘

- 튜닝

- 빅데이터 분석 기사

- Kaggle

- seaborn

- 오라클

- Numpy

- 프로그래머스

- 데이터 분석

- R

- pandas

- 파이썬

- 카카오

- Today

- Total

라일락 꽃이 피는 날

[빅분기 실기] 의사결정나무 (Decision Tree) 본문

의사결정나무 (Decision Tree)

의사결정 규칙을 나무 구조로 도표화하여 관심 대상이 되는 집단을

몇 개의 소집단으로 분류하거나 특정 값을 예측하는 데에 활용되는 분석 방법

직관적으로 결과를 도식화하여 어떻게 분류되는지 알 수 있다.

그러나 분류되는 단계가 많을수록 이해하기 어렵고 데이터에 따라 결과가 안정적이 못하다.

root node (뿌리 마디) = 레이블(y)

intermediate node (중간 마디)

terminal node (끝 마디)

[주요 하이퍼파라미터]

- max_depth : 최대 가지치기 수

- max_leaf_node : 리프 노드의 최대 개수

- min_sample_leaf : 리프 노드가 되기 위한 최소 샘플 수

Part 1. 분류 (Classification)

1. 분석 데이터 준비

import pandas as pd

# 유방암 예측 분류 데이터

data1=pd.read_csv('breast-cancer-wisconsin.csv', encoding='utf-8')

X=data1[data1.columns[1:10]]

y=data1[["Class"]]

1-2. train-test 데이터셋 나누기

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test=train_test_split(X, y, stratify=y, random_state=42)

1-3. Min-Max 정규화

from sklearn.preprocessing import MinMaxScaler

scaler=MinMaxScaler()

scaler.fit(X_train)

X_scaled_train=scaler.transform(X_train)

X_scaled_test=scaler.transform(X_test)

2. 기본모델 적용

2-1. 훈련 데이터

from sklearn.tree import DecisionTreeClassifier

model=DecisionTreeClassifier()

model.fit(X_scaled_train, y_train)

pred_train=model.predict(X_scaled_train)

model.score(X_scaled_train, y_train) # 1.0

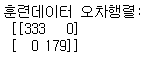

① 오차행렬 (confusion matrix)

from sklearn.metrics import confusion_matrix

confusion_train=confusion_matrix(y_train, pred_train)

print("훈련데이터 오차행렬:\n", confusion_train)

정상 333명, 환자 179명을 정확하게 분류했다.

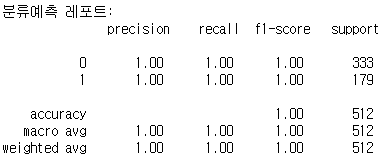

② 분류예측 레포트 (classification report)

from sklearn.metrics import classification_report

cfreport_train=classification_report(y_train, pred_train)

print("분류예측 레포트:\n", cfreport_train)

정밀도(precision) = 1.0, 재현율(recall) = 1.0

2-2. 테스트 데이터

pred_test=model.predict(X_scaled_test)

model.score(X_scaled_test, y_test) # 0.9532163742690059

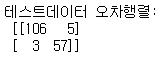

① 오차행렬 (confusion matrix)

confusion_test=confusion_matrix(y_test, pred_test)

print("테스트데이터 오차행렬:\n", confusion_test)

정상(0) 중 5명이 오분류, 환자(1) 중 3명이 오분류되었다.

② 분류예측 레포트 (classification report)

cfreport_test=classification_report(y_test, pred_test)

print("분류예측 레포트:\n", cfreport_test)

정밀도(precision) = 0.95, 재현율(recall) = 0.95

위의 결과를 미루어보아 훈련 데이터에 과대적합된 것 같다.

3. 하이퍼파라미터 튜닝

3-1. Grid Search

param_grid={'max_depth': range(2,20,2), 'min_samples_leaf': range(1,50,2)}max_depth 값을 2부터 20까지 2개 단위로 탐색하고, min_samples_leaf 값을 1부터 50까지 2개 단위로 탐색한다.

from sklearn.model_selection import GridSearchCV

grid_search=GridSearchCV(DecisionTreeClassifier(), param_grid, cv=5)

grid_search.fit(X_scaled_train, y_train)

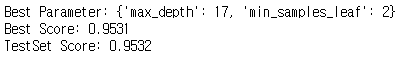

print("Best Parameter: {}".format(grid_search.best_params_))

print("Best Score: {:.4f}".format(grid_search.best_score_))

print("TestSet Score: {:.4f}".format(grid_search.score(X_scaled_test, y_test)))

최적의 max_depth는 6, min_samples_leaf는 1로,

이때 훈련 데이터의 정확도는 95.9%, 테스트 데이터의 정확도는 94.2% 이다.

3-2. Random Search

from scipy.stats import randint

param_distribs = {'max_depth': randint(low=1, high=20),

'min_samples_leaf': randint(low=1, high=50)}랜덤 탐색을 위해 max_depth를 1~20, min_samples_leaf를 1~50 사이의 범위에서

20번(n_iter) 무작위 추출하는 방식을 적용한다.

from sklearn.model_selection import RandomizedSearchCV

random_search=RandomizedSearchCV(DecisionTreeClassifier(),

param_distributions=param_distribs, n_iter=20, cv=5)

random_search.fit(X_scaled_train, y_train)

print("Best Parameter: {}".format(random_search.best_params_))

print("Best Score: {:.4f}".format(random_search.best_score_))

print("TestSet Score: {:.4f}".format(random_search.score(X_scaled_test, y_test)))

최적의 max_depth는 17, min_samples_leaf는 2로,

이때 훈련 데이터의 정확도는 95.3%, 테스트 데이터의 정확도는 95.3% 이다.

Part 2. 회귀 (Regression)

1. 분석 데이터 준비

# 주택 가격 데이터

data2=pd.read_csv('house_price.csv', encoding='utf-8')

X=data2[data2.columns[1:5]]

y=data2[["house_value"]]

1-2. train-test 데이터셋 나누기

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test=train_test_split(X, y, random_state=42)

1-3. Min-Max 정규화

from sklearn.preprocessing import MinMaxScaler

scaler=MinMaxScaler()

scaler.fit(X_train)

X_scaled_train=scaler.transform(X_train)

X_scaled_test=scaler.transform(X_test)

2. 기본모델 적용

2-1. 훈련 데이터

from sklearn.tree import DecisionTreeRegressor

model=DecisionTreeRegressor()

model.fit(X_scaled_train, y_train)

pred_train=model.predict(X_scaled_train)

model.score(X_scaled_train, y_train) # 1.0

2-2. 테스트 데이터

pred_test=model.predict(X_scaled_test)

model.score(X_scaled_test, y_test) # 0.22116121551330037테스트 데이터의 정확도는 22.1%로, 훈련 데이터와 격차가 너무 크다.

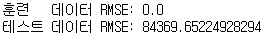

① RMSE (Root Mean Squared Error)

import numpy as np

from sklearn.metrics import mean_squared_error

MSE_train = mean_squared_error(y_train, pred_train)

MSE_test = mean_squared_error(y_test, pred_test)

print("훈련 데이터 RMSE:", np.sqrt(MSE_train))

print("테스트 데이터 RMSE:", np.sqrt(MSE_test))

훈련 데이터에 과대하게 적합된 모델 결과라는 것을 알 수 있다.

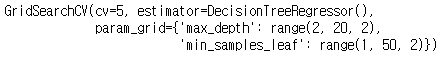

3. 하이퍼파라미터 튜닝

3-1. Grid Search

param_grid={'max_depth': range(2,20,2), 'min_samples_leaf': range(1,50,2)}max_depth 값을 2부터 20까지 2개 단위로 탐색하고, min_samples_leaf 값을 1부터 50까지 2개 단위로 탐색한다.

from sklearn.model_selection import GridSearchCV

grid_search=GridSearchCV(DecisionTreeRegressor(), param_grid, cv=5)

grid_search.fit(X_scaled_train, y_train)

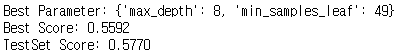

print("Best Parameter: {}".format(grid_search.best_params_))

print("Best Score: {:.4f}".format(grid_search.best_score_))

print("TestSet Score: {:.4f}".format(grid_search.score(X_scaled_test, y_test)))

최적의 max_depth는 8, min_samples_leaf는 49로,

이때 훈련 데이터의 정확도는 55.9%, 테스트 데이터의 정확도는 57.7% 이다.

3-2. Random Search

from scipy.stats import randint

param_distribs = {'max_depth': randint(low=1, high=20),

'min_samples_leaf': randint(low=1, high=50)}랜덤 탐색을 위해 max_depth를 1~20, min_samples_leaf를 1~50 사이의 범위에서

20번(n_iter) 무작위 추출하는 방식을 적용한다.

from sklearn.model_selection import RandomizedSearchCV

random_search=RandomizedSearchCV(DecisionTreeRegressor(),

param_distributions=param_distribs, n_iter=20, cv=5)

random_search.fit(X_scaled_train, y_train)

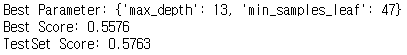

print("Best Parameter: {}".format(random_search.best_params_))

print("Best Score: {:.4f}".format(random_search.best_score_))

print("TestSet Score: {:.4f}".format(random_search.score(X_scaled_test, y_test)))

최적의 max_depth는 13, min_samples_leaf는 47로,

이때 훈련 데이터의 정확도는 55.8%, 테스트 데이터의 정확도는 57.6% 이다.

'데이터 분석 > 빅데이터 분석 기사' 카테고리의 다른 글

| [빅분기 실기] 투표기반 앙상블 (Voting Ensemble) (0) | 2022.06.19 |

|---|---|

| [빅분기 실기] 랜덤 포레스트 (Random Forest) (0) | 2022.06.18 |

| [빅분기 실기] 서포트 벡터머신 (SVM) (0) | 2022.06.18 |

| [빅분기 실기] 인공신경망 (0) | 2022.06.17 |

| [빅분기 실기] 나이브 베이즈 (Naive Bayes) (0) | 2022.06.16 |